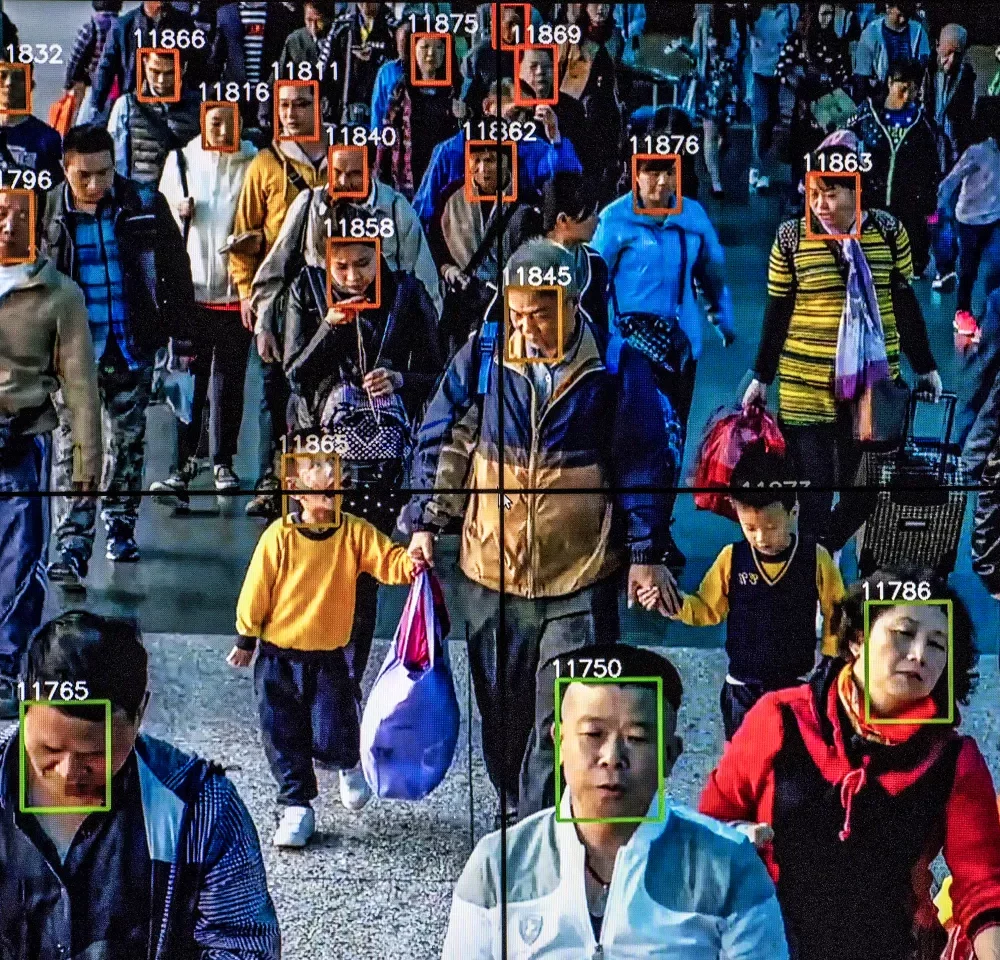

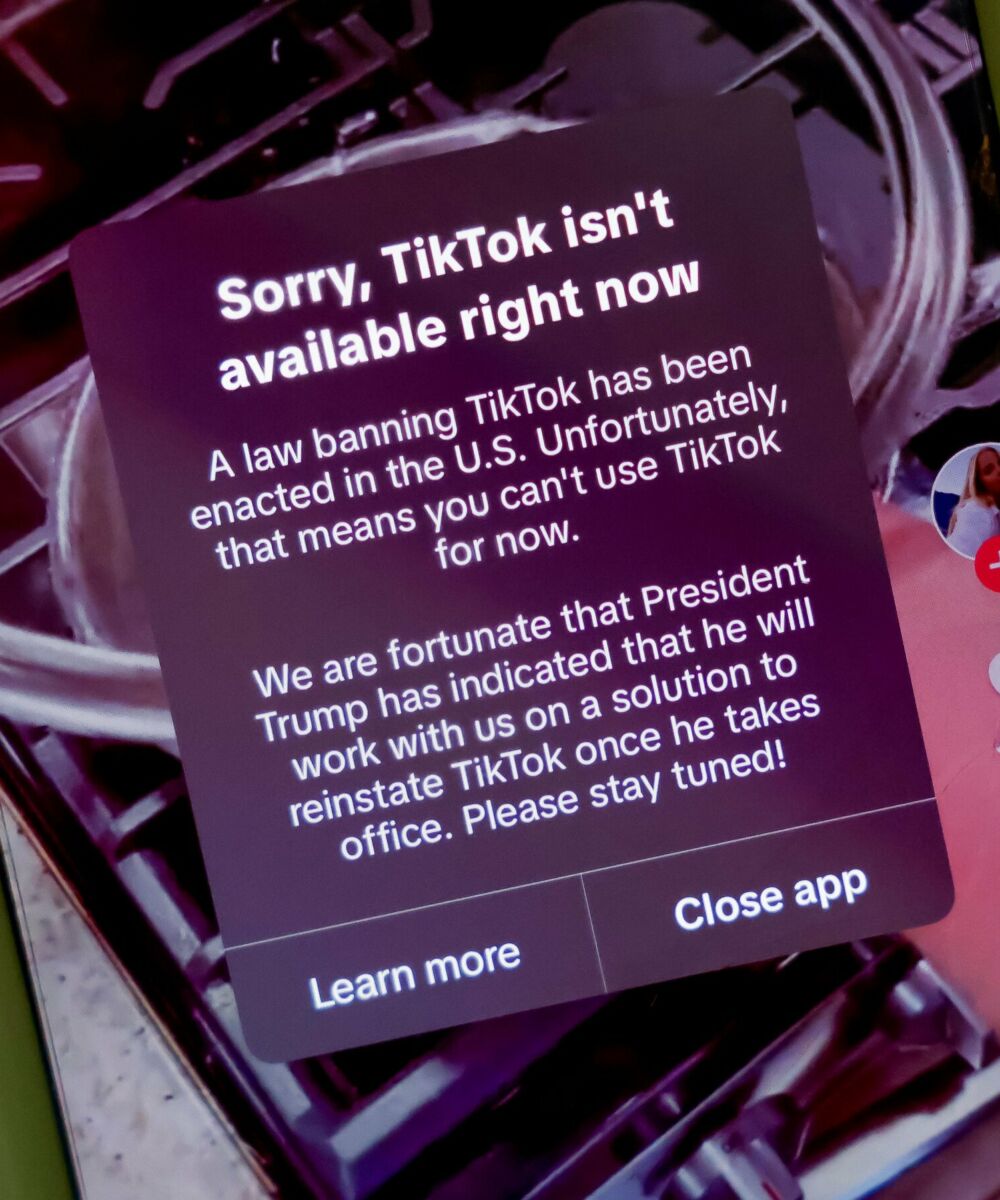

Nel 2006, Jennifer Crecente, una giovane statunitense di 18 anni, venne brutalmente uccisa dal suo ex fidanzato a Austin, in Texas. Quasi due decenni dopo, il padre, Drew, ha ricevuto un avviso che lo ha sconvolto: il nome e l’immagine di sua figlia erano stati utilizzati per creare un chatbot basato su IA, sulla piattaforma Character.AI.

La creazione del chatbot è avvenuta senza il permesso della famiglia e la descrizione fornita dalla piattaforma non corrispondeva a Jennifer, ma si basava sul lavoro del fratello di Drew. Nonostante l’azienda abbia rimosso il chatbot dopo la segnalazione, episodi di questo tipo si verificano sempre più spesso. Anche in Italia.

Emblematico è il caso di Giulia Cecchettin, ragazza di 22 anni uccisa un anno fa dal suo ex fidanzato Filippo Turetta. Di entrambi sono stati creati diversi chatbot, sempre su Character.AI, che simulavano la voce e l’identità dei due ragazzi, consentendo agli utenti di parlare con loro e addirittura di chiamarli al telefono. L’avatar di Turetta, in particolare, sembrava giustificare il femminicidio e non mostrare alcun segno di rimorso nelle risposte fornite.

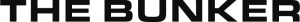

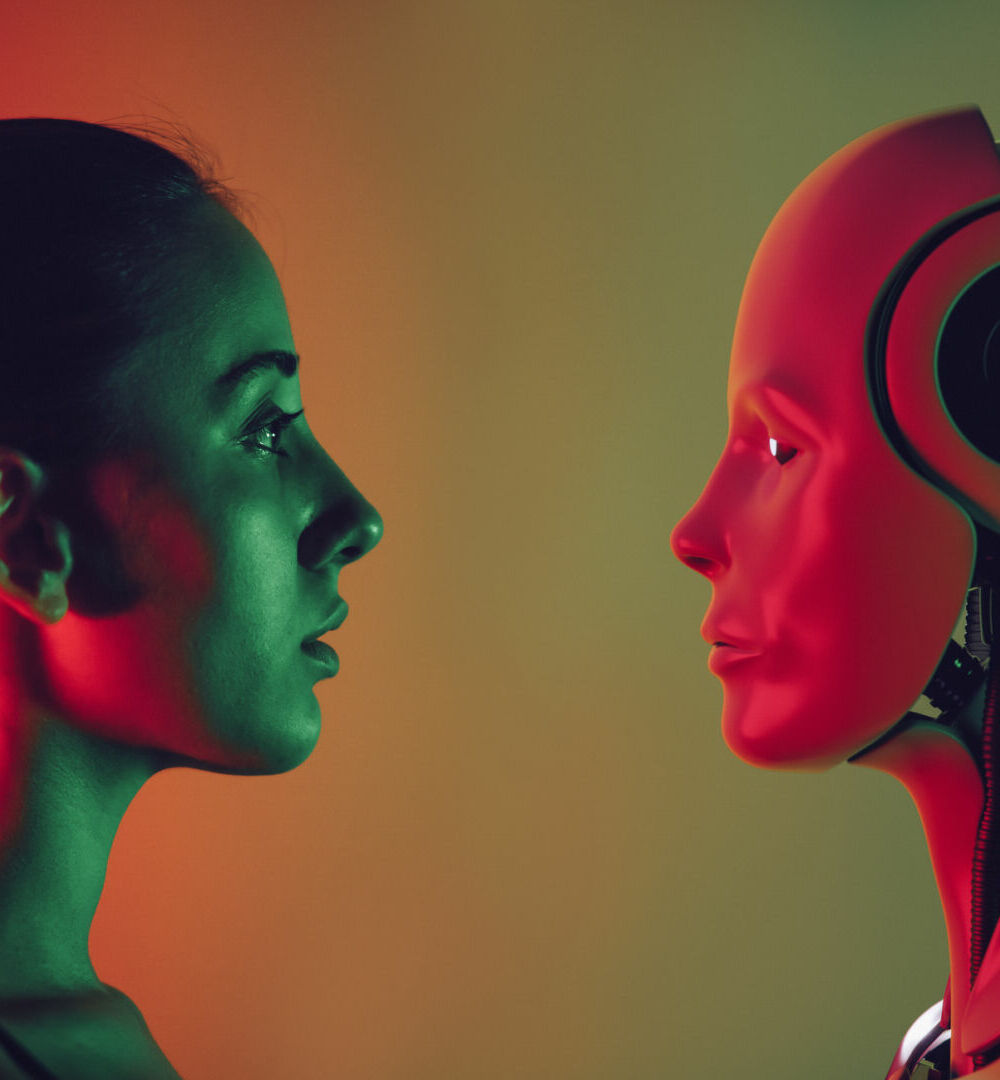

Ci sono anche casi in cui le persone decidono volontariamente di utilizzare l’IA per creare degli avatar dei propri cari defunti. È stato persino coniato un nome apposito per questo tipo di chatbot: deadbot o griefbot. Questi chatbot con IA in pratica simulano una conversazione con una persona defunta utilizzando le tracce digitali da lei lasciate intenzionalmente (post sui social, chat, e-mail, etc.) o non intenzionalmente (registri delle chiamate, ricerche sul web, etc.).

Secondo i ricercatori dell’Università di Cambridge questo tipo di tecnologia però rischia di causare danni psicologici e di ‘perseguitare’ digitalmente le persone che ne fanno uso. La ricerca mostra, infatti, un utilizzo spregiudicato dei deadbot da parte delle aziende per promuovere pubblicità ingannevole o per angosciare i bambini insistendo sul fatto che un genitore morto sia in realtà ancora presente.

Questi esempi evidenziano la necessità di una regolamentazione più rigorosa dei griefbot per evitare di danneggiare le persone già traumatizzate da eventi violenti e per garantire che i diritti dei defunti e degli eredi vengano rispettati.

“Dobbiamo iniziare a pensare ora a come mitigare i rischi sociali e psicologici dell’immortalità digitale, perché la tecnologia è già qui”, ha dichiarato Nowaczyk-Basińska, coautrice dello studio.

Alessandro Mancini

Laureato in Editoria e Scrittura all’Università La Sapienza di Roma, è giornalista freelance, content creator e social media manager. Tra il 2018 e il 2020 è stato direttore editoriale della rivista online che ha fondato nel 2016, Artwave.it, specializzata in arte e cultura contemporanea. Scrive e parla soprattutto di arte contemporanea, lavoro, disuguaglianze e diritti sociali.