ACIDS: nuovi modelli di interazione fra musica e macchine

di Pierluigi Fantozzi

Uscire dalla pandemia è stato come svegliarsi in un’altra epoca. Improvvisamente ciascuno di noi ha avuto a disposizione intelligenze artificiali capaci di risolvere problemi complessi, generare immagini di ogni tipo o persino scrivere e interpretare canzoni. Ma tra una foto del papa in full look Balenciaga e un jingle generato per un’inserzione sui social, ci siamo ben presto ritrovati fra le mani anche una preoccupazione: l’AI sarà la morte del lavoro creativo? La risposta ovviamente è no. La sperimentazione musicale, ad esempio, sembra trarre enorme giovamento da queste tecnologie.

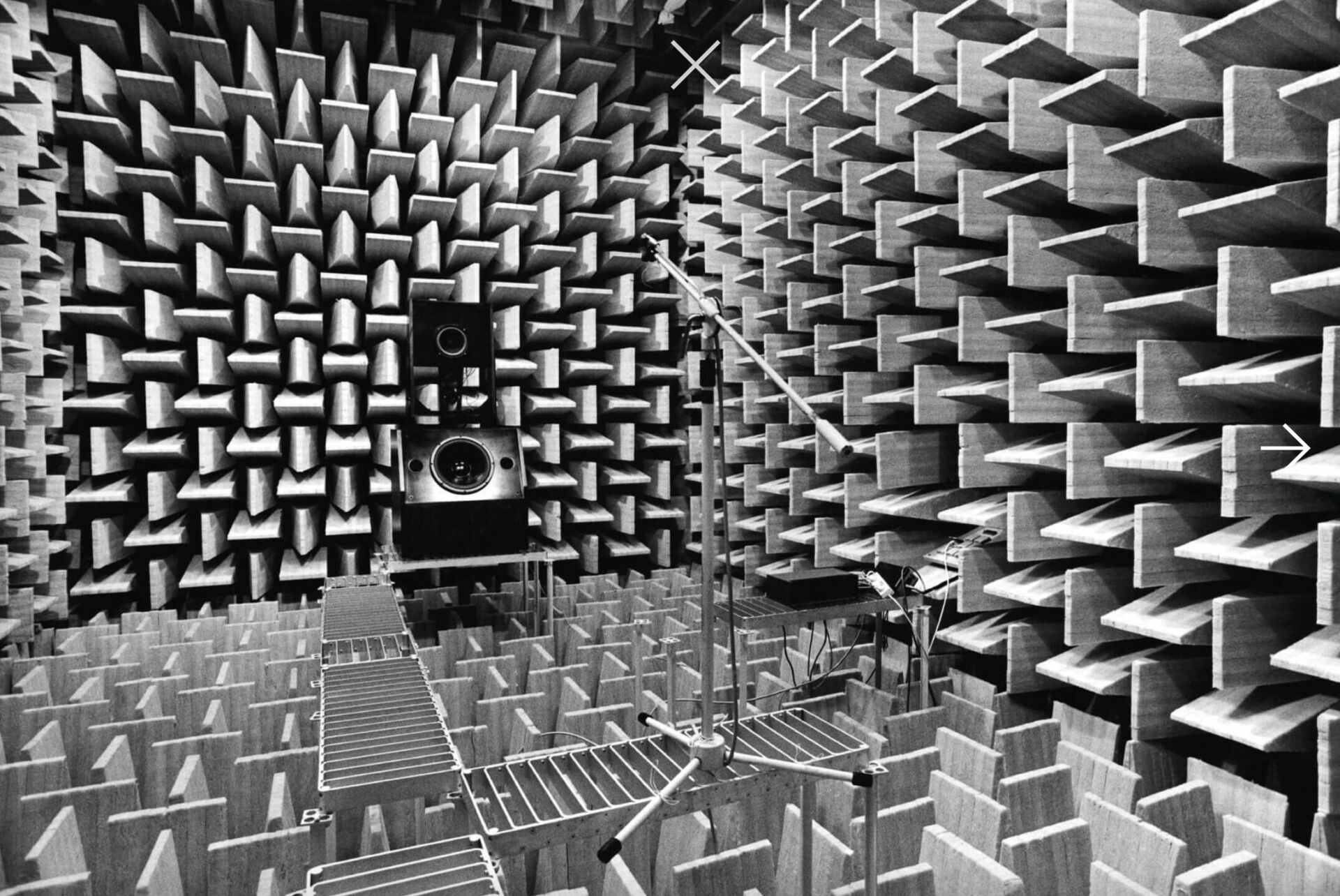

Lo sanno bene ad IRCAM, l’Istituto per la ricerca e la coordinazione acustica/musicale di Parigi, dove da anni un team specializzato studia nuovi modelli di interazione fra musicisti e software di intelligenza artificiale. Quel team si chiama ACIDS (Artificial Creative Intelligence and Data Science), e sarebbe riduttivo considerarlo solo un team di ingegneri informatici specializzati, perché ACIDS è a tutti gli effetti un collettivo artistico. Fa riferimento alla figura di Philippe Esling, ed è attualmente composto da quattro dottorandi, a cui si aggiungono ricercatori e artisti collaboratori. Tra i traguardi più importanti del team c’è lo sviluppo di RAVE, software basato sull’intelligenza artificiale, che gli è valso il premio Digital Musics & Sound Art al festival Ars Electronica.

RAVE nasce contestualmente alla realizzazione di Convergence, una composizione del 2021, nata dalla collaborazione di ACIDS con il compositore Alexander Schubert. RAVE è un software open source, e chiunque può scaricarlo sul proprio computer e testarlo. Basta munirsi di una DAW (Ableton Lite o FL Studio, per esempio oppure di software come MaxMSP e PureData) e creare un account sul sito dell’Ircam. È un modello di trasferimento del timbro che a partire da input audio, genera potenzialmente qualsiasi tipo di strumento sotto forma di file audio in alta qualità. In parole povere, un ritmo registrato con le mani può diventare un sample di darbouka, e un urlo può diventare un bordone di un violoncello. Il tutto in tempo reale ed in altissima definizione.

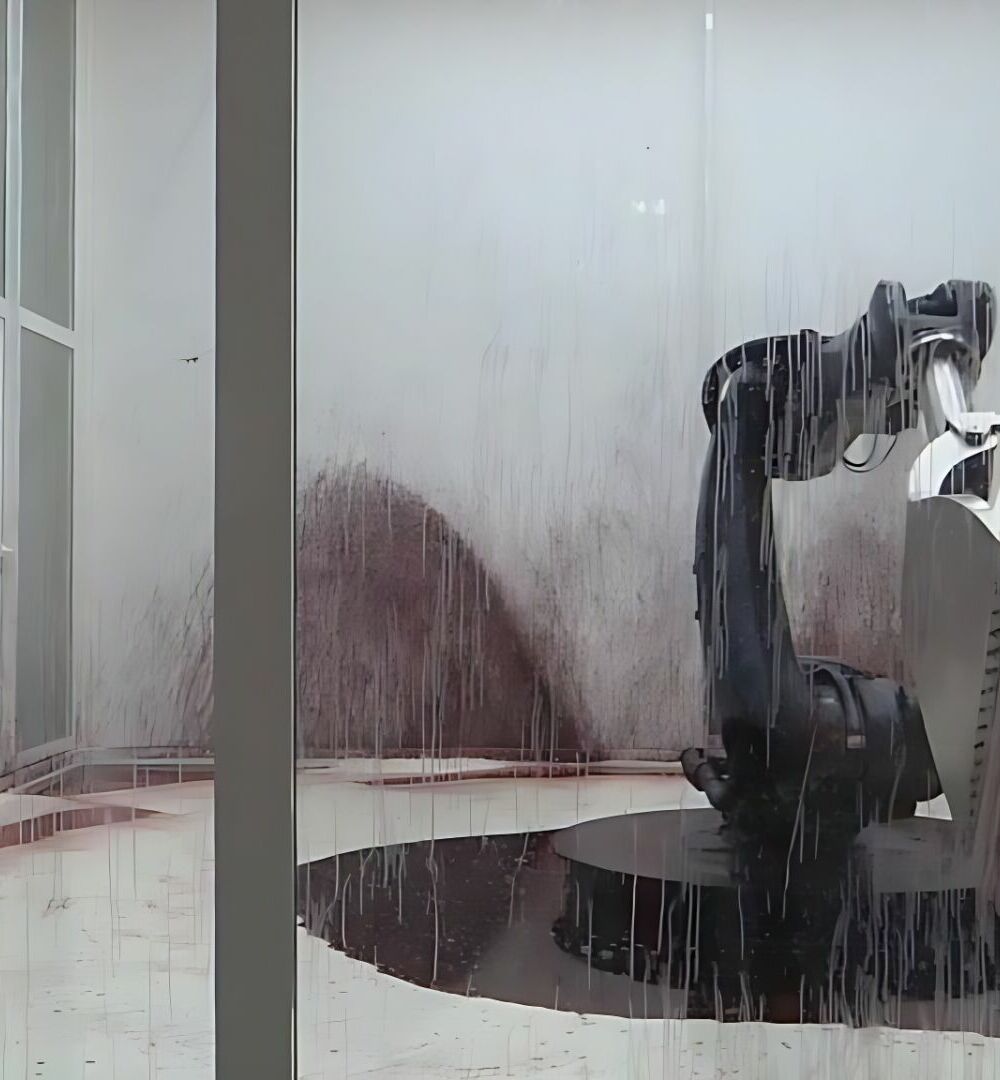

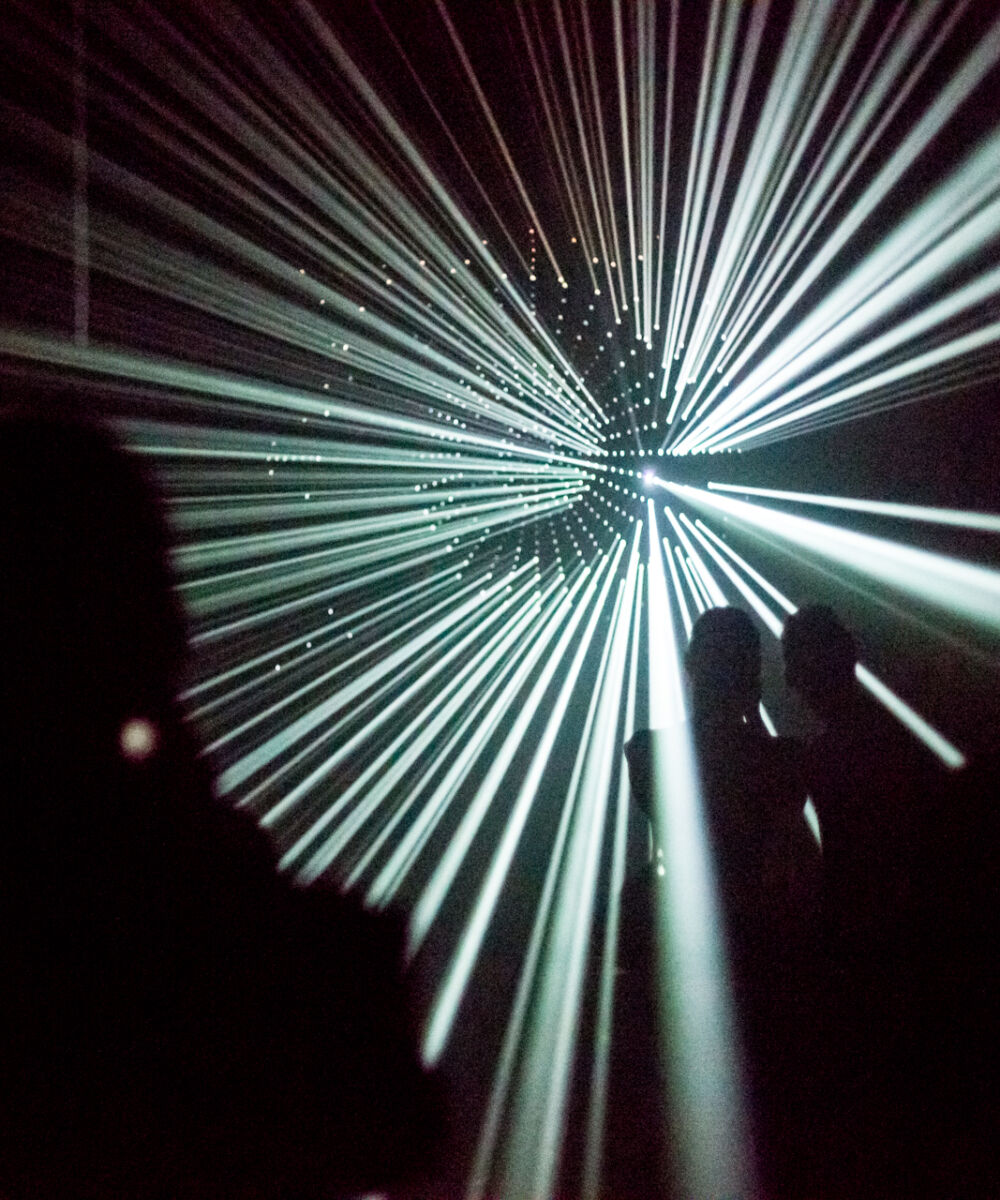

ACIDS e Schubert hanno perfezionato questo strumento per realizzare Convergence, una performance audiovisiva di 34 minuti in cui un ensemble di musicisti dialoga e improvvisa con degli omologhi virtuali, che rispondono agli input istantaneamente.

Le strade che si aprono alla sperimentazione musicale sono tantissime. Adesso disponiamo di modelli digitali in grado di improvvisare simultaneamente con un musicista, ed in modo incredibilmente efficiente. Il processo creativo ne esce rafforzato anziché nullificato, perché anche se si tratta di un’intelligenza artificiale, è comunque un modello per cui la componente umana è indispensabile.

Tuttavia c’è anche una criticità che presto potrebbe presentare il conto. Le leggi globali in merito di AI non sono ancora al passo coi tempi. Intelligenze artificiali come RAVE vengono istruite con sample pre-esistenti per riuscire a produrre dei suoni, dato che ovviamente non li producono dal nulla. La domanda è: un sample prodotto da RAVE si può considerare originale ed esente dal diritto d’autore? O, al contrario, si deve pensare come una variazione all’ennesima potenza del sample con cui il modello è stato istruito? Sulla questione persiste un vuoto legislativo.

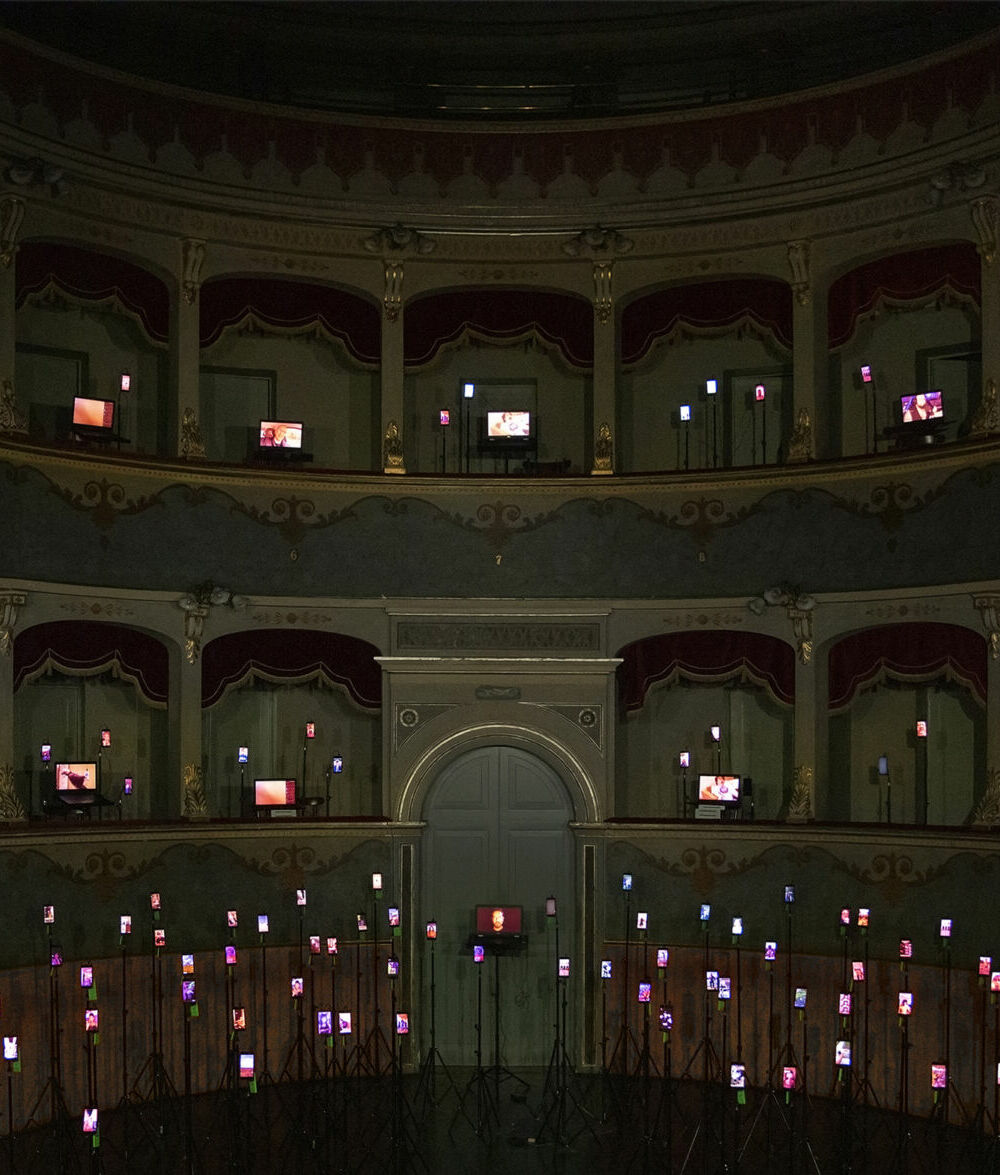

Al di là di questa criticità, al momento l’intelligenza artificiale sembra essere una risorsa nell’ambito della sperimentazione musicale più che una minaccia. E ACIDS sta giocando un ruolo fondamentale in questo scenario. Le tecnologie messe a punto dal team continuano ad essere sviluppate ed applicate a nuovi progetti: le collaborazioni recenti vedono coinvolti Canblaster, del collettivo francese Club Cheval, e l’artista americana Holly Herndon. Canblaster ha presentato il suo ultimo lavoro con una release all’IRCAM il 9 ottobre, mentre Holly Herndon ha realizzato un’installazione a Hyde Park a Londra, lo scorso 5 ottobre.

ACIDS non rappresenta solo una nuova frontiera della musica: è la dimostrazione che l’intelligenza artificiale può essere uno strumento per potenziare, non per sostituire, l’estro umano. In questo dialogo continuo tra artisti e macchine, il futuro non è un’incognita minacciosa, ma una promessa. La creatività non muore, si evolve. E con progetti come quelli di ACIDS, abbiamo davanti un nuovo paradigma: uno in cui l’ingegno umano e la potenza delle macchine si intrecciano per dar vita a espressioni artistiche che, fino a ieri, erano inimmaginabili.

Un ringraziamento speciale a Giovanni Bindi del team ACIDS.

CONSIGLI Di ASCOLTO

Pierluigi Fantozzi

Pierluigi Fantozzi, 1995, è un musicista. Si è laureato all’Accademia Nazionale del Jazz di Siena, conseguendo il titolo magistrale al Conservatorio di Bologna. Clarinettista, ha militato in formazioni jazz, ma ha coltivato un interesse nei confronti della musica elettronica, collaborando anche con Tempo Reale. Dal 2023, entra a far parte del team di Controradio, per cui ha realizzato interviste a importanti figure della scena musicale internazionale. In veste di speaker radiofonico, è alla guida del suo programma “Passabanda”.